Artificial Deficiency

And the deification of machines

As Honest AI has grown in trust and readership, we’ve started receiving several contributor pitches. If you’d like to write for Honest AI, you can share your idea here.

This article was translated into English using Google Translate, edited by Dr. Alberto Chierici, and finally signed off by the author. For the Italian readers, you can jump to the end to read the original article.

Grazie, Gioele!

How many of us have seen The Matrix? Putting aside the philosophical and computer science references the film is packed with, I want to highlight the general setting in which the story unfolds. We find ourselves in a future where humanity, after an unparalleled technological leap, ends up at war with its own creations—machines that have become so “evolved” they have subjugated and enslaved almost the entire human race.

Those who escape this fate live underground, waiting for a messiah, “The One.” The entire plot revolves around this war: Man vs. Machine, Creator vs. Creature.

The current AI boom mirrors the rise of LLMs. But what are they? What does this curse word actually mean? LLM stands for Large Language Model. These are algorithms—very complex, yes, but ultimately just mathematical formulas—that humans invented and exploited thanks to the ever-increasing computation speed of computers. AI, being the finished product of calculations performed by multiple servers, is purely virtual.

Ethics and Washing Machines

I want to bring the focus on ethics’ so let me first define it. Here, we define Ethics as the ability to reason and discern between good and evil. Consequently, speaking of “AI Ethics” is a delusion and a contradiction in terms.

Consider this: If we load a washing machine with glass tumblers, run a spin cycle, and then get angry because everything is broken, whose fault is it? Is the washing machine responsible? Did it fail its “ethics”? No. It performed the purpose for which it was programmed. The machine is innocent; the responsibility for the error is ours.

This simple example demonstrates three fundamental characteristics of AI:

Amoral: It acts regardless of implications. It is without “amore” (love).

Contextless (Deficient): It is “deficient” in the true Latin sense of the word (deficio, meaning “lacking”). It cannot understand context or intent from a prompt alone, nor can it mitigate its response based on nuance.

Without Ethics: It cannot know if its actions are right or wrong.

Why do we struggle to judge AI clearly? Without trying to untangle the entire Gordian knot, let’s look at the symptoms.

When we chat with AI, it responds as if it were human, using “I” and feigning consciousness or feelings. This generates a false sense of empathy in our brains. It works both ways: men abuse female-coded AI, and conversely, 70% of users on the AI companionship app “Dippy” prefer male characters, suggesting many users are women seeking connection (Wired, 2024). And that happens because AI looks like “on of us.” We have deceived ourselves: we have empathized with the machine, attributing to it feelings and stirrings of the human soul that it does not possess. Let’s remember it is just a machine. That is, ultimately, just a string of 0s and 1s on electronic devices called computers and servers.

But I want to offer another reflection.

The New Human Sacrifice

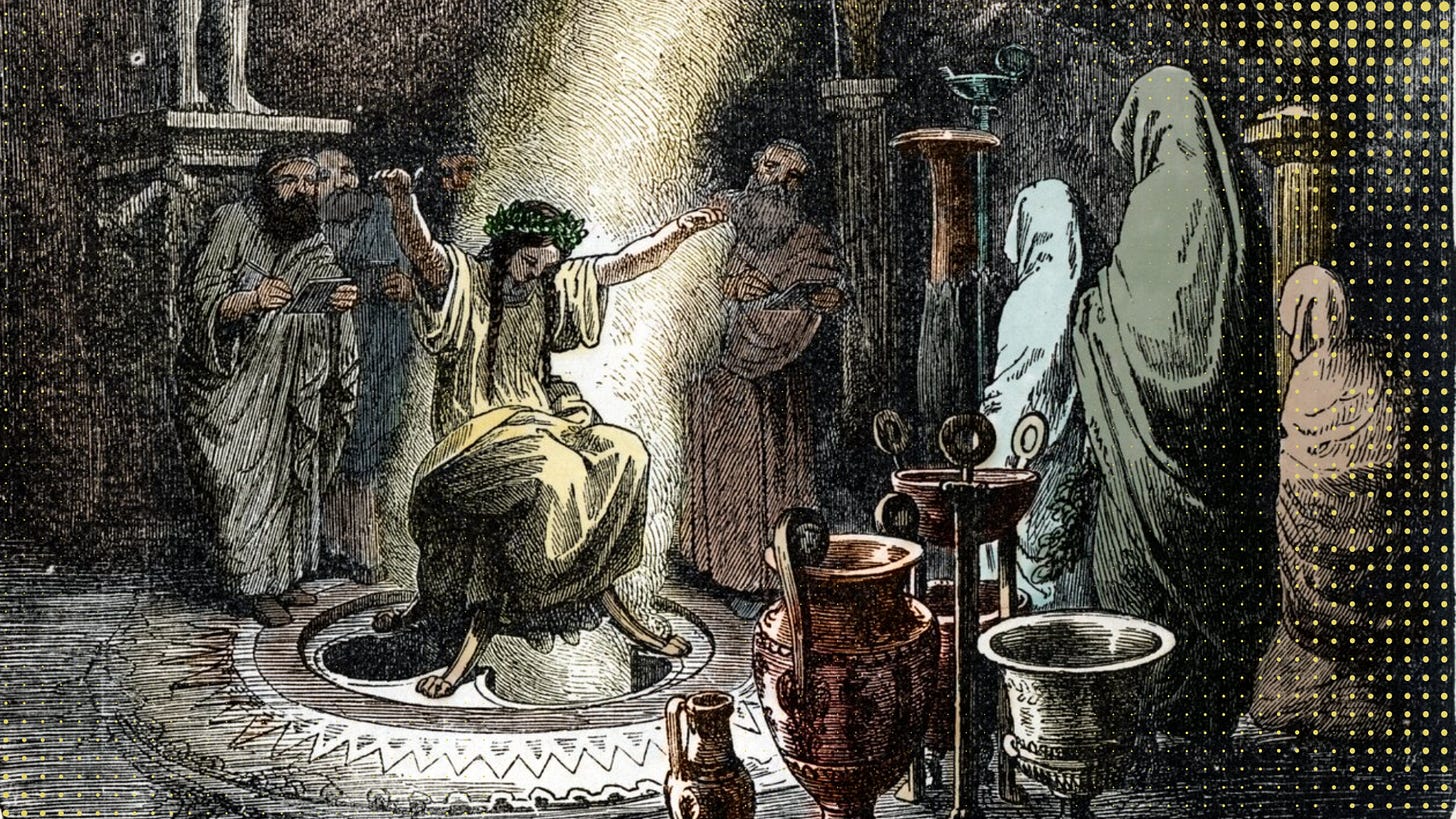

We treat AI like a modern Oracle, expecting it to solve all our problems. Most people don’t realize these models are trained on data up to a specific time. Ask about something recent, and it either hallucinates (invents facts) or searches the web just like we would. Research shows that AI accuracy drops drastically as problems become more complex or unique. We have turned AI into an Oracle that provides ordinary answers to ordinary problems.

This reveals a hard truth we could learn by simply slowing down: our problems are rarely unique. Someone else has faced what we are facing. The AI knows the answer only because it has read thousands of human texts discussing the same struggle.

We look back at ancient civilizations—the Phoenicians, Egyptians, Aztecs—and smile at how they anthropomorphized unknown forces, elevating them to gods and offering them sacrifices, often human ones, to secure a future.

Today, we are doing the exact same thing scientifically and massively. We are sacrificing our privacy and our children’s futures to the deity of Information Technology. We feed AI models with our habits, photos, and intimate data to make them “smarter,” all while rendering ourselves more tracked and commodified for the economic benefit of a few tech owners.

The “Sharenting” Crisis

Think of a child today. How will they reach adolescence when their parents have already shared their entire young lives online? Anyone can know their most intimate aspects. What moral authority will we have as educators if we have splashed our own indiscretions everywhere? How is redemption or a “new life” possible if our digital past constantly returns to accuse us?

In our narcissistic and nihilistic society, the sacredness of Human Life has been ousted by market value. To quote Nietzsche, “God is dead”—or rather, Man has killed God and, deceived by the “Ancient Serpent,” believes he can be God.

By elevating ourselves to divine status, we have lost the horizon of the transcendent. We find ourselves naked and afraid, chasing virtual worlds. We ignore the physical cost: while we talk of a green transition, we ignore the massive energy consumption required by data centers to power this technology. We act like sheep, accepting mediocrity as long as we get our scraps.

Artificial Deficiency (AD)

The core pathology is that we have discarded our divine principle and attributed human roles to our artifacts. We call it AI, but it is really AD (Artificial Deficiency). If we have lost our own ethical roots, how can we judge the ethics of our machines?

This leads to two consequences:

The threat of control becomes real simply because people believe in it and follow it (like stock market speculation).

We become lonelier, cynical, and afraid of the future.

We must ask: Who is looking out for the youth? Do they really need this technology as urgently as we think, or is our euphoria instilling fear in them?

The Tool, Not the Idol

Is this technology absolute evil? Absolutely not. If we can restore the centrality of the Human and the Divine Principle in our society, we can use this tool as a tool, without deifying it or fearing a Matrix-style rebellion.

I leave you with an invitation and a provocation:

The Invitation

Do not fall into the trap of empathy. The machine has NO HEART. It has neither humanitas nor pietas. It can describe these concepts with perfect words, but it remains a cold instrument without a soul. Remember that.

The Provocation

Isn’t it paradoxical that we are working tirelessly to give AI human-like features, while simultaneously building unreal, virtual worlds for ourselves to live in? Do we really want to virtualize ourselves while giving physicality to the virtuality of AI?

I don’t know if the future will be like The Matrix, but today, are we already blocking out the Sky?

Gioele Raiano is a software developer, and a curious mind who values dialogue with specialists across fields.

Original version

Deficienza Artificiale

Chi di noi ha mai visto il film Matrix? Lasciando da parte tutti i riferimenti filosofico-informatici di cui il film ne è pieno, vorrei invece evidenziarne l’ambientazione generale in cui la storia si va dipanando. Siamo in un futuro in cui l’umanità, dopo un salto tecnologico senza eguali, si ritrova in guerra contro le proprie opere, ossia le macchine, divenute tanto “evolute” da soggiogare e rendere schiava praticamente la totalità degli umani. Chi non è soggetto a simile destino, oltre a vivere sottoterra, è in attesa del messia, dell’eletto.

Tutta l’azione quindi si svolge all’interno della guerra uomo vs macchina, della creatura vs il creatore.

Il boom dell’IA è specchio di quello occorso agli LLM. Ma cosa sono, cosa significa questa parolaccia? LLM sta per Large Langue Model e fa riferimento alla creazione di grandi modelli linguistici, ma cosa sono questi modelli linguistici? Gli LLM sono algoritmi (molto complessi ma pur sempre formule matematiche) che l’uomo ha inventato e definito potendo sfruttare le capacità e velocità di calcolo dei computer. Pertanto l’IA, essendo il prodotto nel senso di manufatto finito di una serie di calcoli fatti da molteplici server, è puramente virtuale.

Volendo portare il focus del discorso sull’etica, fissiamo in primis cosa definisco con etica. Per ETICA qui intenderemo la capacità di ragionamento e discernimento nel capire cosa sia buono e cosa male, ne segue quindi che parlare di ETICA dell’IA è un inganno a noi stessi e un controsenso in termini propri. È come se noi caricassimo una lavatrice con dei bicchieri di vetro, le facessimo eseguire la centrifuga e poi ci arrabbiassimo perché sono tutti rotti.

Ora, di chi sarebbe la responsabilità del danno? Della lavatrice? Essa ha mancato alla propria “etica”? Allo scopo per il quale è stata progettata e programmata? La risposta in questo caso è ovvia: la macchina è innocente e la responsabilità dell’errore è nostra.

Paradossalmente, con questo semplicissimo esempio, abbiamo dimostrato tre caratteri fondamentali dell’IA. Essa è:

Amorale: agisce sempre e a prescindere, senza alcuna preoccupazione circa le implicazioni e conseguenze. Amorale: senza amore.

Senza Contesto: è deficiente, nel senso latino del termine: deficio ossia mancante. Non è in grado, dalla sola domanda, di capire il contesto ed il fine e, in conseguenza, mitigare e affinare la risposta.

Non Etica: non è in grado di sapere se il suo agire sia bene o male, giusto o sbagliato.

E allora, davanti a queste palesi evidenze, perché non riusciamo ad avere né ad essere così lucidi, fermi e decisi nel giudizio dell’IA?

Senza la presunzione di riuscire a dipanare la Tela di Arianna, vedremo, con pochi semplici esempi, come la risposta sia “molte manifestazioni di una sola patologia”.

Iniziamo col dire che, quando dialoghiamo e interroghiamo le varie IA, ad esempio sul futuro o su argomenti prettamente umani, esse rispondono includendosi nel dialogo come se, in qualche modo, avessero coscienza, capacità di ragionamento e sentimenti. Come se le loro preoccupazioni fossero le stesse delle nostre ossia come se noi e loro fossimo tutte persone umane. Questo primo sintomo è uno dei più cruciali.

Il fatto che l’IA risponda come se fosse una persona umana genera nel nostro cervello, a livello più o meno inconsapevole, l’inganno dell’empatia e della vicinanza. È cosa nota che ci sono persone di sesso maschile che sfruttano l’IA come sesso femminile da aggredire, umiliare e svilire ma è anche vero il contrario: dichiara Jagga, fondatore di Dippy app IA di “compagnia”, “il 70% degli account di Dippy tende a preferire personaggi maschili, il che potrebbe indicare che molti utenti si identificano come donne” (Wired, 2024). E questo perché l’IA è “una di noi”. Ci siamo ingannati: siamo entrati in empatia con la macchina, abbiamo riconosciuto alla macchina dei sentimenti, dei movimenti dell’animo umano che essa non ha. Ricordiamoci che, in ultima analisi, essa è solo una serie di 0 e di 1 su dei dispositivi elettronici chiamati computer e server.

Altro spunto di riflessione che desidero portare in evidenza. L’IA ci sembra onnisciente e la panacea a tutti i nostri problemi: chiediamo ed essa risponde a mo’ anzi meglio degli antichi Oracoli! I più di noi però non sanno che i modelli, le varie versioni di IA, vengono addestrati con informazioni esistenti al tempo specifico X. Al tempo X+1 il modello non ha risposta e deve cercarla su internet, come farebbe ciascuno di noi, oppure fornisce una risposta senza né capo né coda, a volte anche inventandosi le fonti dalle quali ha preso spunto, in gergo tecnico si dice che ha avuto un’allucinazione. Inoltre, una recente ricerca ha dimostrato che la percentuale di accuratezza delle risposte tecniche fornite in ambito di sviluppo cala drasticamente alla complessità, all’unicità del problema e di quanto esso sia temporalmente più recente rispetto dal momento dell’addestramento. Abbiamo reso l’IA il nostro Oracolo moderno che fornisce risposte ordinarie a problemi ordinari ossia comuni a tutti noi.

Un altro inganno al quale potremmo facilmente ovviare rallentando un momento le nostre vite e che l’IA stessa, essendo addestrata su migliaia di testi umani, ci porta in evidenza: il nostro problema NON è unico, non è il nostro esclusivo. Qualcun altro sta o è stato come noi, nella medesima situazione. Qualcun altro si sta ponendo le nostre stesse domande.

Ho definito l’IA come il nostro Oracolo Moderno ed ho altresì fatto riferimento alla situazione empatica di questa tecnologia rendendo a noi così ardua la trattazione etica.

Noi oggi bonariamente ridiamo e guardiamo ai Popoli Antichi le cui credenze e sistemi politico-religiosi tendevano ad antropizzare, a dare fattezze e comportamenti umani, praticamente ad ogni Forza Ignota e queste venivano elevate al rango divino e a loro l’uomo offriva sacrifici imbonitori, sacrifici spesso umani: schiavi, prigionieri, giovani donne vergini, principesse e principi… pensiamo ai Fenici, agli antichi egizi, ai miti greci ma anche alle Civiltà Precolombiane come gli Aztechi, giusto per citarne una. Loro sacrificavano il futuro dei propri figli e noi oggi, in modo scientifico e massivamente, stiamo facendo la medesima cosa: stiamo sacrificando non solo noi stessi ma anche il futuro dei nostri figli. Basti pensare ai dati che condividiamo e che, più o meno consapevolmente, cediamo come, ad esempio, abitudini e siti online ma anche foto nostre, dei nostri figli, nipoti, amici. Tutti questi dati sono una medaglia che, se da un lato, viene usata come cibo con il quale i modelli di IA vengono fatti crescere e istruiti affinché forniscano risposte migliori, dall’altro, con l’idea di essere più “smart”, moderni e giovani direi: “all’altezza dei nostri tempi”, sono un modo per renderci sempre più schiavi e conosciuti, più tracciati e assimilati ai dati e ai numeri che produciamo: senza dignità, senza umanità per il vantaggio economico dei pochi proprietari e di questa tecnologia e dei modelli matematico-statistico di cui fa largo uso.

Pensando ad un qualsiasi nostro figlio di oggi, mi chiedo: come arriverà all’adolescenza dopo che già noi genitori gli abbiamo condiviso tutta la giovane vita online?! Praticamente chiunque potrà conoscerne anche gli aspetti più intimi e privati.

E questo senza pensare a quello che un domani i nostri nipoti o figli potranno dire delle nostre “bravate di oggi”! Quale sarà e qual è la nostra autorità di educatori se avremo spiattellato ovunque bravate e pensieri?! Come sarà possibile la redenzione, un cambiamento, una nuova vita se ad ogni passo avremo una qualche informazione tornata dal passato ad accusarci: chi siamo, cosa siamo stati e a ricordare quanto accaduto?!

Stiamo sacrificando la privacy e le informazioni nostre, e non solo, alla divinità Tecnologia Informatica, all’IA come se questa possa salvarci o elevarci al rango divino. Tutto questo oggi è palesemente sotto i nostri occhi, nelle nostre società narcisistiche e nichiliste dove la centralità e sacralità della Vita Umana (che ha un inizio, uno svolgimento ed una fine) sono state spodestate dal denaro, dalla produzione compulsiva dei valori economici e dal mercato.

Oggi al tempo della secolarizzazione ecco che sembra essere diventato reale l’irrealizzabile, per citare Nietzsche: “Dio è morto”, meglio: l’Uomo ha ucciso Dio, l’Uomo si è lasciato ingannare (ancora) dal Serpente Antico secondo le cui menzogne noi possiamo essere come Dio. Ecco quindi che, essendoci alzati al rango divino, abbiamo perso l’Orizzonte Alto del Cielo, la nostra parte trascendete (anche se poi alziamo torri e grattacieli sempre più alti quasi a cercarla inconsciamente) e ci troviamo nudi e impauriti a rincorrere Mondi Virtuali la cui promessa di idealità è sempre più spostata a domani ma, al contempo, affinché la promessa di “domani” possa realizzarsi è sempre più necessario il fomento, l’assiduità e il soggiogamento di tutti in favore del guadagno di pochi.

Ragioniamo anche sulle bugie o le verità non dette: parliamo tanto di transizione verde, di decarbonizzazione del mondo ma quanti sanno, quanti conoscono l’energia necessaria ai vari datacenter solo per il funzionamento di questa tecnologia? Siamo consapevoli dell’inquinamento prodotto oppure, come pecore al pascolo, evitiamo domande e ci accontentiamo della mediocrità purché si abbia il pezzo di pane?

Ecco, quindi, che le varie argomentazioni superficialmente qui trattate sono le diverse facce della medesima patologia: cestinando e disconoscendo il Principio Divino, oggi l’Uomo ha perso se stesso e riconosce ai propri artefatti, tra i quali l’IA o meglio la DA (Deficienza Artificiale) che quasi brilla di luce propria, un ruolo e comportamento che non hanno. Se abbiamo perso, cestinato o disconosciuto i nostri valori storici, le nostre radici, la nostra etica (di società, di popoli e personale) oggi tutte cose così vetuste, come possiamo adeguatamente valutare e giudicare l’etica, se esiste, dei nostri artefatti?!

Questa difficoltà ha due conseguenze immediate:

l’aspetto di minaccioso controllo (dell’IA, della divinità Tecnologia) da ipotesi diviene e diverrà tanto più reale e certo quante più persone lo seguiranno, un po’ come per le speculazioni in borsa;

diveniamo sempre più soli, egoisti, cinici, vuoti dentro, sospettosi e impauriti del domani e di ogni cosa che pensiamo possa minacciare la nostra vita, il nostro status quo e benessere. Quindi, eccoci qui a scrivere e ragionare su noi e di noi adulti in rapporto alla modernità ma chi si è preoccupato dei nostri giovani? Di coloro che oggi stanno entrando nella vita adulta? Ci siamo accorti della paura che la nostra euforia per la DA sta ponendo in loro?! Di come LORO vedono e vivono questo aspetto della tecnologia da noi creata e in creazione? Ne hanno davvero un bisogno così urgente e viscerale che merita il nostro sforzo così importante?

Quanto fin qui esposto vuol quindi bollare questo artefatto come male assoluto?! Assolutamente no! Se saremo capaci di porre l’Uomo (e non il dato che è, che rappresenta o che potrebbe generare), se saremo capaci di far ritornare la Sacralità della nostra Vita ed il Principio Divino che alberga al centro delle nostre società, dei nostri modelli di business saremo allora capaci di adoperare lo strumento (ed ogni altro frutto dell’ingegno) come tale senza alcuna divinizzazione né conflitto o paura che l’artefatto si ribelli all’artigiano.

Vorrei quindi concludere indicando un aspetto ed un invito che trovo fondamentali:

[invito] non cadiamo nell’inganno, nell’illusione dell’empatia con la macchina, essa NON HA cuore! Non ha né humanitas né alcuna pietas, può descriverle con le parole migliori ma resta fredda, uno strumento senza cuore né anima. Ricordiamocelo.

[provocazione] non è paradossale come l’uomo stia alacremente lavorando per dare fattezze umanoidi all’IA, ad una serie di calcoli matematici, mentre per se stesso si stia costruendo una serie di mondi irreali e virtuali basati su una serie di 0 e 1?

Davvero vogliamo virtualizzarci e dare fisicità alla virtualità dell’IA?

In ultima analisi: non so se il futuro sarà come presentatoci in Matrix ma oggi ci stiamo forse oscurando il Cielo?

Grazie per l’attenzione.

Gioele Raiano

Love this perspective! So, AI being purely virtual, how does that fit the ethics?